谷歌AI奠基論文被指“翻車”!開山鼻祖給AI帶來了什么?

“武功再高,也怕菜刀”。就算是開山鼻祖,也有翻車的一天。

現階段類GPT(Generative Pre-trained Transformer)的語言大模型像雨后春筍一樣,不斷涌現。雖說這股浪潮是由ChatGPT引爆,但在這所有AI大模型的背后其實還有一個更關鍵的技術概念——Transformer架構。

然而就在今天,有人扒出來提出Transformer架構的論文《Attention Is All Your Need》翻車了!論文里面的圖片和代碼是不一致的。

2017年,谷歌大腦團隊發表了名為《Attention Is All Your Need》的論文,在論文里他們開創性的提出了Transformer架構。此后它成了NLP(自然語言處理)領域最受歡迎的模型之一,也正是有了這個架構,我們才能見到ChatGPT這樣的AI大模型。

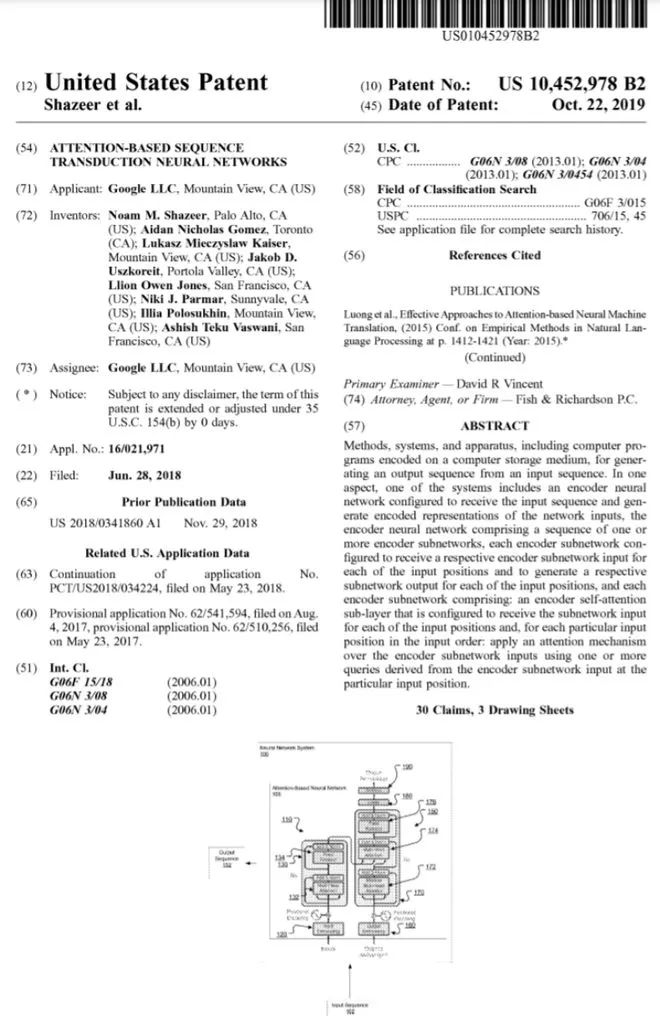

所以業內都把Transformer架構奉為AI領域的奠基石,這篇論文也成為了AI探索和研究的“金科玉律”。2019年,谷歌特地為該架構申請了專利。

據資料顯示,自2017年發表以來,《Attention Is All Your Need》這篇論文已經被引用了7萬多次。現在被曝出論文可能出錯了,這不得不讓整個AI圈震驚。

“開山鼻祖”竟然翻車了?

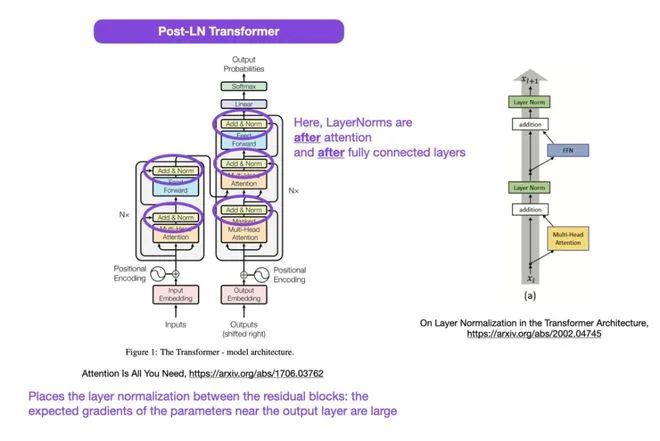

發現錯誤的是一位知名機器學習與 AI 研究者、初創公司 Lightning AI 的首席 AI 教育家 Sebastian Raschka。他指出,原始 Transformer 論文中的架構圖有誤,這跟代碼不一致。

他結合了另外兩篇同樣涉及Transformer架構的論文,來佐證《Attention Is All Your Need》里的出現的結構圖是不對的,可能會導致表示崩潰。這對于一篇指導了幾乎所有AI開發的論文來說,是不能接受的。

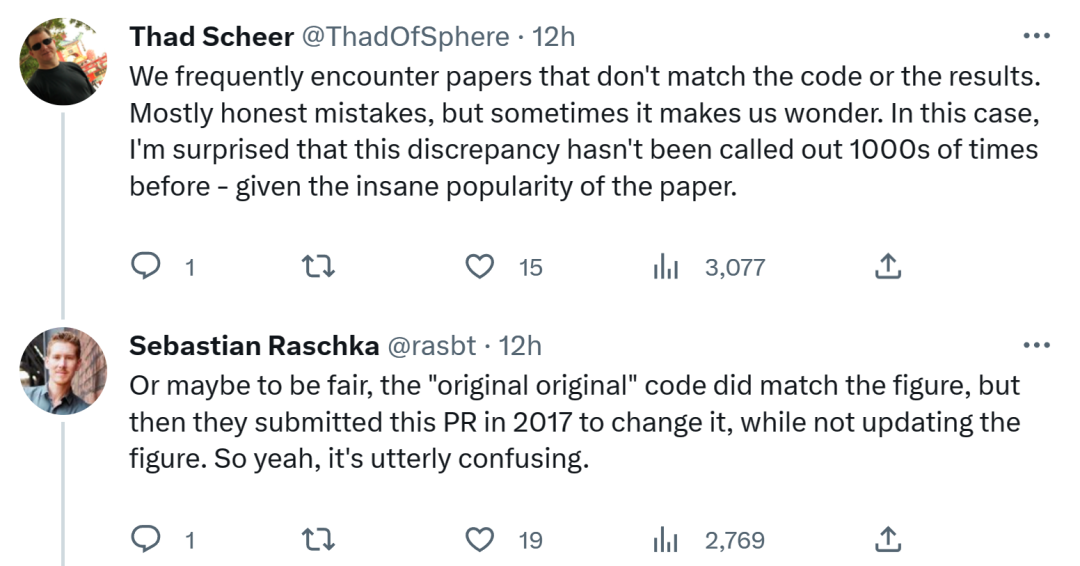

針對他提出的錯誤,有網友認為經常會遇到與代碼或結果不一致的論文,大多數是無心之過;但有時令人感到奇怪。考慮到 Transformer 論文的流行程度,這個不一致問題早就應該被提及 1000 次。

對此 Sebastian表示,公平地講,“最最原始”的代碼確實與架構圖一致,但 2017 年對提交的代碼版本進行了修改,同時沒有更新架構圖。所以,這實在令人困惑。

“奠基石”也并非一勞永逸

Transformer架構“教出”了一批優秀的學生,讓AI領域獲得前所未有的關注,也昭示了AI技術的發展方向。

但業界對技術的追求,一直都不滿足現狀。

經過大量實踐,開發者發現凡是采用Transformer架構的類GPT大模型,都有共同的缺陷,就是太容易健忘,一旦輸入序列的token超過上下文窗口閾值,后續輸出的內容和前文邏輯就對不上了。

ChatGPT只能支持4000個token(約3000個詞)的輸入,目前地表最強的GPT-4也只支持最大32000token窗口,如果繼續加大輸入序列長度,計算復雜度也會成二次方增長。

前段時間,倫敦數學科學研究所的研究人員發布了一篇技術報告,使用循環記憶Transformer(RMT)將BERT的有效上下文長度提升到前所未有的200萬tokens。該方法可以存儲和處理局部和全局信息,并通過使用循環讓信息在輸入序列的各segment之間流動。

百度在推出文心一言大模型之后,不停地對其進行訓練,并加快了迭代速度。

在5月9日舉行的百度文心一言技術交流會上,百度集團副總裁侯震宇表示,下一階段人工智能大模型的創新還要從前沿理論研究方面尋找突破口,就比如說探尋突破Transformer框架的方式。

開山論文的締造者,已各奔東西

最近,OpenAI 聯合創始人 Ilya Stutskever 在談到 Transformer 時表示,當 Transformer 剛發布之初,實際上是論文放出來的第二天,他們就迫不及待的將以前的研究切換到 Transformer ,后續才有了 GPT。

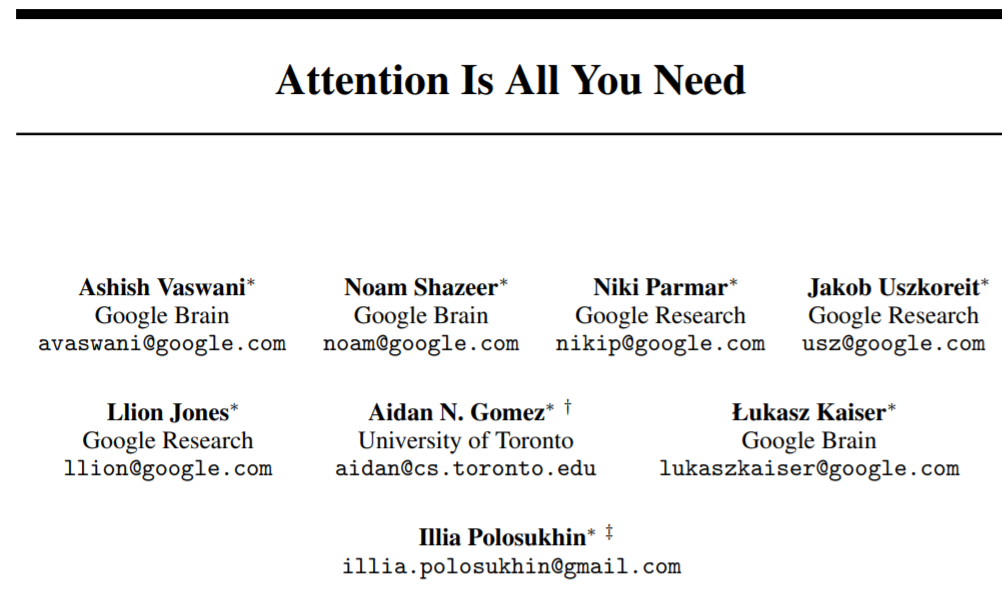

而作為Transformer的締造者——《Attention Is All Your Need》論文作者們,大多都選擇了自己的道路。

Ashish Vaswani、Niki Parmar等人共同創立了Adept,根據披露的消息這是一家跟OpenAI競爭的大模型公司。目前已經獲得了4.15億美元的融資,且估值超過10億美元。

Noam Shazee在 2000 年底加入谷歌,直到 2021 年最終離職。2021年,他和他的朋友Daniel De Freitas一起創立了CharacterAI。這是一家虛擬人聊天AI公司,能生成各種不同人格的虛擬人支持陪聊。目前已經獲得了近2億美元的融資。

2021 年,Jakob Uszkoreit 和 Rhiju Das 共同創立了 Inceptive,致力于通過高度可擴展的實驗和深度學習的奇異結合來實現下一代 RNA 分子的設計,已經獲得了2000萬美元的融資。

Llion Jones是8人中目前唯一還在谷歌工作的。他聲稱對論文作出了最有意義的貢獻:寫下了Attention is all you need這個響亮的標題。

Aidan Gomez于2019年9月離開Google。2021 年 5 月,他官宣成立新公司——自然語言處理平臺 Cohere,基于自己訓練的大型 NLP 模型為外界提供 API 服務。目前已經獲得了近4億美元的融資,員工人數超過180名。

Lukasz Kaiser也是知名的機器學習系統Tensor Flow的共同創造者之一,2021 年 6 月,Lukasz Kaiser 從谷歌跳槽到了 OpenAI。

Illia Polosukhin現在是 NEAR.AI 的聯合創始人及 CTO。這是一家區塊鏈底層技術公司,目前估值約為20億美元。

請輸入評論內容...

請輸入評論/評論長度6~500個字

最新活動更多

- 1 AI狂歡遇上油價破百,全球股市還能漲多久? | 產聯看全球

- 2 OpenAI深夜王炸!ChatGPT Images 2.0實測:中文穩、細節炸,設計師慌了

- 3 6000億美元估值錨定:字節跳動的“去單一化”突圍與估值重構

- 4 Tesla AI5芯片最新進展總結

- 5 連夜測了一波DeepSeek-V4,我發現它可能只剩“審美”這個短板了

- 6 熱點丨AI“瑜亮之爭”:既生OpenClaw,何生Hermes?

- 7 AI界的殺豬盤:9秒刪庫跑路,全員被封號,還繼續扣錢!

- 8 2026,人形機器人只贏了面子

- 9 DeepSeek降價90%:價格屠夫不是身份,是戰略

- 10 AI Infra產業鏈卡在哪里了?

分享

分享