一文帶你重新思考BatchNorm中的Batch

前言

公眾號在前面發過三篇分別對BatchNorm解讀、分析和總結的文章(文章鏈接在文末),閱讀過這三篇文章的讀者對BatchNorm和歸一化方法應該已經有了較深的認識和理解。在本文將介紹一篇關于BatchNorm舉足輕重的論文,這篇論文對進行了很多實驗,非常全面地考慮了BatchNorm中的Batch。

歡迎關注公眾號 CV技術指南 ,專注于計算機視覺的技術總結、最新技術跟蹤、經典論文解讀。

Motivation

BatchNorm 區別于其他深度學習算子的關鍵因素是它對批量數據而不是單個樣本進行操作。BatchNorm 混合批次中的信息以計算歸一化統計數據,而其他算子獨立處理批次中的每個樣本。因此,BatchNorm 的輸出不僅取決于單個樣本的屬性,還取決于樣本分組的方式。

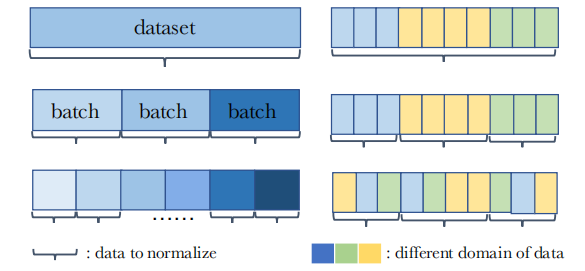

如上左圖所示,按照采樣大小,上中下三圖表示BatchNorm的采樣方式分別為entire dataser、mini-batches和subset of mini-batches。

如上右圖所示,按照采樣風格,上中下三圖表示BatchNorm的采樣方式分別為entire domain、each domain和mixture of each domain。

論文研究了 BatchNorm 中批處理的這些選擇,證明了在不考慮批處理構建的不同選擇的情況下,應用批處理規范可能會在許多方面產生負面影響,但可以通過在批處理方式上做出謹慎選擇來提高模型性能。

Review of BatchNorm

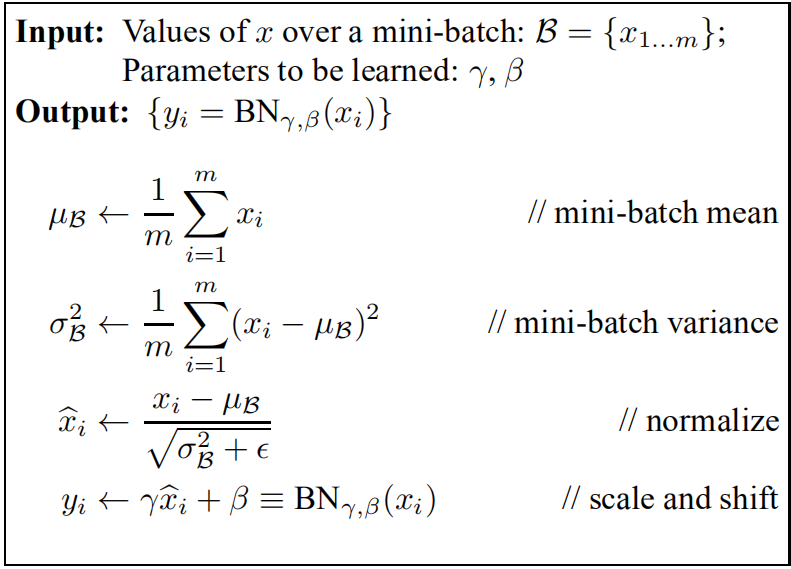

在一個mini-batches中,在每一BN層中,對每個通道計算它們的均值和方差,再對數據進行歸一化,歸一化的值具有零均值和單位方差的特點,最后使用兩個可學習參數gamma和beta對歸一化的數據進行縮放和移位。

此外,在訓練過程中還保存了每個mini-batches每一BN層每一通道的均值和方差,最后求所有mini-batches均值和方差的期望值,以此來作為推理過程中該BN層各自通道的均值和方差。

Whole Population as a Batch

在訓練期間,BatchNorm 使用mini-batch的樣本計算歸一化統計數據。但是,當模型用于測試時,通常不再有 mini-batch 的概念。最初提出BatchNorm是在測試時,特征應該通過在整個訓練集上計算的總體統計數據 μ、σ 進行歸一化。這里的 μ、σ 被定義為批次統計量 ?, σ 使用整個population作為“Batch”。

廣泛使用EMA 算法來計算 ?, σ,但它并不總是能準確地訓練population數據,因此論文提出了新的算法PreciseBN。

Inaccuracy of EMA

EMA: exponential moving average

算法公式如下:

由于以下原因,EMA會導致模型估計Population數據次優:

當 λ 很大時,統計數據收斂緩慢。由于每次更新迭代僅對 EMA 貢獻一小部分 (1-λ),因此 EMA 需要大量更新才能收斂到穩定的估計值。隨著模型的更新,情況變得更糟:EMA 主要由過去的輸入特征主導,隨著模型的訓練這些特征已經過時。

當 λ 較小時,EMA 統計數據由較少數量的近期mini-batch主導,并不代表整個populatioin。

PreciseBN

PreciseBN通過以下兩個步驟來近似Population統計數據。

(固定)模型在許多小批量上應用來收集Batch統計數據;

將per-batch統計數據聚合為總體統計數據。

與EMA相比,PreciseBN多了兩個重要的屬性:

統計數據完全根據固定模型狀態計算,與使用模型歷史狀態的 EMA 不同;

所有樣本的權重相等。

實驗結論

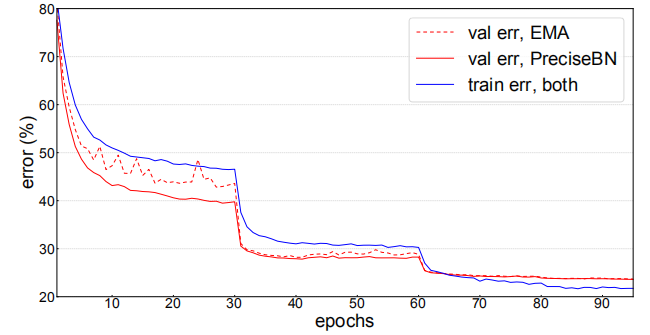

1.PreciseBN比BN更穩定。

2.當batchsize很大時,EMA算法不穩定。作者認為不穩定性是由大批量訓練中損害 EMA 統計收斂性的兩個因素造成的:(1)32 倍大的學習率導致特征發生更劇烈的變化;(2) 由于總訓練迭代次數減少,EMA 的更新次數減少了 32 倍。

3.PreciseBN只需要個樣本就可以得到穩定的結果。

4.小Batch會累計誤差。

Batch in Training and Testing

在訓練和推理期間使用的Batch統計量不一致:訓練期間使用mini-batch統計數據,推理期間使用訓練期間所有mini-batch通過EMA算法近似得到的population統計數據。論文分析了這種不一致對模型性能的影響,并指出在某些情況下可以輕松消除不一致以提高性能。

為了避免混淆,將SGD batch size或者total batch size定義為所有GPU上總的batch size大小,將normalization batch size定義為單個GPU上的batch size大小。(注:這一點在《歸一化方法總結》一文中有提到,當使用多個GPU時,實際的mini-batch統計數據只基于batchsize/GPU數的樣本上統計)

normalization batch size對訓練噪聲和訓練測試不一致性有直接影響:較大的Batch將mini-batch統計數據推向更接近總體統計數據,從而減少訓練噪聲和訓練測試不一致

為了便于分析,論文觀察了3種不同評估方法的錯誤率:

在訓練集上對mini-batch統計量進行評估

在驗證集上對mini-batch統計量進行評估

在驗證集上對population統計量進行評估

實驗結論

小的normalization batch size(例如 2 或 4)性能不佳,但如果使用mini-batch統計數據(藍色曲線),該模型實際上具有不錯的性能。結果表明,mini-batch統計和總體統計之間的巨大不一致是影響mini-batch性能的主要因素。

另一方面,當normalization batch size較大時,小的不一致可以提供正則化以減少驗證錯誤。這導致紅色曲線比藍色曲線表現更好。

基于以上結論,論文給出兩個消除不一致用來提高性能的方法

Use Mini-batch in Inference

Use Population Batch in Training

Batch from Different Domains

BatchNorm 模型的訓練過程可以被視為兩個獨立的階段:首先通過 SGD 學習特征,然后通過 EMA 或 PreciseBN 使用這些特征訓練總體統計數據。我們將這兩個階段稱為“SGD training”和“population statistics training”。

在本節中,論文分析出現domain gap的兩種情況:當模型在一個domain上訓練但在其他domain上測試時,以及當模型在多個domain上訓練時。這兩者都會使 BatchNorm 的使用復雜化。

實驗結論

當存在顯著的域偏移時,模型在對評估中使用的domain會比使用 SGD 訓練,進行總體統計訓練后獲得最佳錯誤率。直觀地說,根據domain組成Batch可以減少訓練測試的不一致并提高對新數據分布的泛化能力。

BatchNorm 在mixture of multi-domain data上的domain-specific training在以前的工作中經常被提出,名稱為“Domain-Specific BN”、“Split BN”、“Mixture BN”,“Auxiliary BN”,“Transferable Norm”。這些方法都包含以下三種選擇中的一些。

Domain-specific SGD training

Domain-specific population statistics

Domain-specific affine transform

通過消除上述三個選擇,我們表明在 SGD training和population statistics training之間使用一致的策略很重要,盡管這種實現可能看起來不直觀。

Information Leakage within a Batch

我在《歸一化方法總結》中總結到,BN的三個缺陷之一便是當mini-batch中的樣本非獨立同分布時,性能比較差,作者認為這是由于Information Leakage導致的。

論文實驗發現,當使用random采樣的mini-batch統計量時,驗證誤差會增加,當使用population統計量時,驗證誤差會隨著epoch的增加逐漸增大,驗證了BN信息泄露問題的存在。

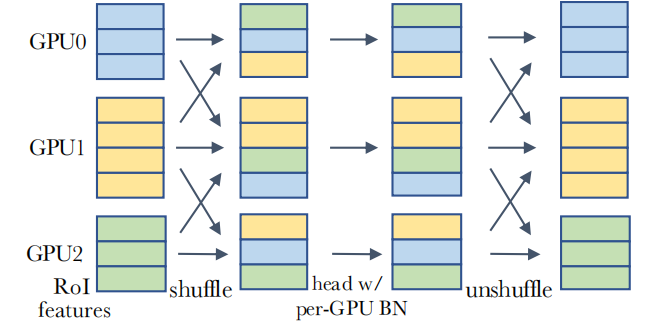

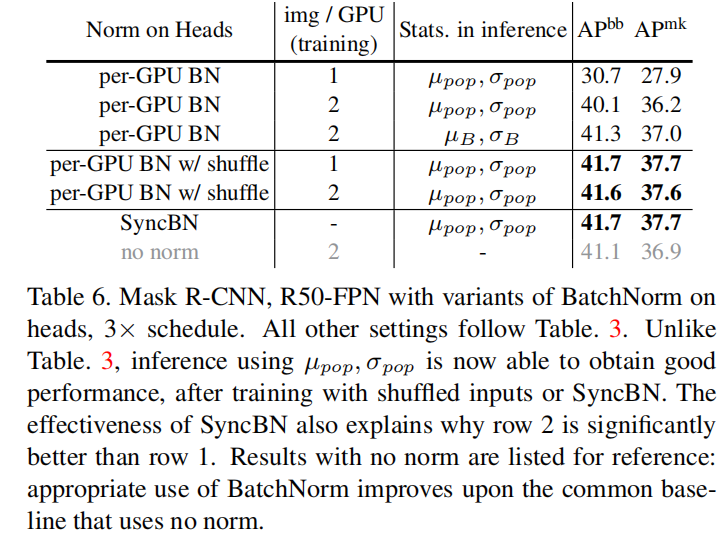

為了處理信息泄露問題,之前常見的做法是使用SyncBN,來弱化mini-batch內樣本之間的相關性。另一種解決方法是在進入head之前在GPU之間隨機打亂RoI features,這給每個GPU分配了一個隨機的樣本子集來進行歸一化,同時也削弱了min-batch樣本之間的相關性,如下圖所示。

如下圖所示,實驗證明 shuffling和 SyncBN 都有效地解決了信息泄漏問題,允許head在測試時很好地概括population statistics。

在速度方面,對于深度模型,shuffle 需要較少的 cross-GPU 同步,但每次同步傳輸的數據比 SyncBN 層傳輸的數據多。因此,它們的相對效率因模型架構而異。據比SyncBN多。因此,shuffling和SyncBN的相對效率跟具體模型架構相關。

總結

本文回顧了BatchNorm算法;分析了使用mini-batches計算的統計數據和基于population作為batch計算的統計數據的效果,提出了PreciseBN近似統計算法,該算法相比于常用的EMA算法有更穩定的效果;分析了根據不同domain來組成mini-batch的效果差異;分析了處理mini-batch中的樣本非獨立同分布情況的兩種方法。

結合前面的三篇文章《Batch Normalization》、《可視化的BatchNorm--它的工作方式以及為什么神經網絡需要它》、《歸一化方法總結 | 又名"BN和它的后浪們"》,相信讀者會對BatchNorm會有一個非常全面的認識,并進一步加深對神經網絡的理解。

本文來源于公眾號 CV技術指南 的論文分享系列。

歡迎關注公眾號 CV技術指南 ,專注于計算機視覺的技術總結、最新技術跟蹤、經典論文解讀。

請輸入評論內容...

請輸入評論/評論長度6~500個字

最新活動更多

- 1 AI狂歡遇上油價破百,全球股市還能漲多久? | 產聯看全球

- 2 OpenAI深夜王炸!ChatGPT Images 2.0實測:中文穩、細節炸,設計師慌了

- 3 6000億美元估值錨定:字節跳動的“去單一化”突圍與估值重構

- 4 Tesla AI5芯片最新進展總結

- 5 連夜測了一波DeepSeek-V4,我發現它可能只剩“審美”這個短板了

- 6 熱點丨AI“瑜亮之爭”:既生OpenClaw,何生Hermes?

- 7 AI界的殺豬盤:9秒刪庫跑路,全員被封號,還繼續扣錢!

- 8 2026,人形機器人只贏了面子

- 9 DeepSeek降價90%:價格屠夫不是身份,是戰略

- 10 AI Infra產業鏈卡在哪里了?

分享

分享